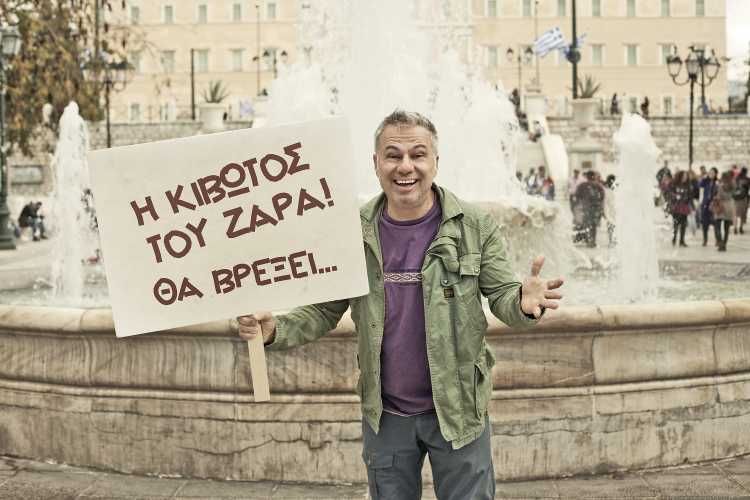

Την Τετάρτη 8 Μαρτίου, το Κοινοβούλιο ενέκρινε (523 υπέρ, 46 κατά και 49 αποχές) τον νόμο περί τεχνητής νοημοσύνης που διασφαλίζει την ασφάλεια και τη συμμόρφωση με τα θεμελιώδη δικαιώματα, ενώ ενισχύει την καινοτομία. Το libre ανοίγει το νέο μαγικό παράθυρο που ανοίγεται μπροστά μας και μπαίνουμε στα βαθιά της τεχνητής νοημοσύνης. Ο πλέον ειδικός, Νίκος Βασιλάκος, δημοσιογράφος τεχνολογίας εξηγεί τι ακριβώς ψηφίστηκε στο Ευρωκοινοβούλιο, ενώ λύνει για πρώτη φορά λεπτομερώς απορίες που υπάρχουν γύρω από τον νέο ανεξερεύνητο κόσμο του ΑΙ. Ποια είναι τα οφέλη; Τι κινδύνους κρύβει και πώς μπορούμε να προφυλαχθούμε;

Ο κανονισμός, που συμφωνήθηκε στις διαπραγματεύσεις με τα κράτη μέλη τον Δεκέμβριο του 2023, στοχεύει στην προστασία των θεμελιωδών δικαιωμάτων, της δημοκρατίας, του κράτους δικαίου και της περιβαλλοντικής βιωσιμότητας από την τεχνητή νοημοσύνη υψηλού κινδύνου, αλλά και να ενισχύσει παράλληλα την καινοτομία και να αναδείξει την Ευρώπη ως πρωτοπόρο δύναμη στον τομέα αυτό. Γι’ αυτόν τον σκοπό, ο κανονισμός ορίζει διαφορετικές υποχρεώσεις για τα συστήματα τεχνητής νοημοσύνης, ανάλογα με τους πιθανούς κινδύνους και τις επιπτώσεις που ενέχει η χρήση τους.

Σε προηγούμενο ρεπορτάζ είχαμε μιλήσει για την τεχνητή νοημοσύνη, με αφορμή ανάλυση του Διεθνούς Νομισματικού Ταμείου (ΔΝΤ) που ανέφερε πως το ΑΙ αναμένεται να επηρεάσει σχεδόν το 40% όλων των θέσεων εργασίας.

Αυτή τη φορά, μπαίνουμε για τα καλά στον μαγικό κόσμο του ΑΙ. Ο δημοσιογράφος τεχνολογίας Νίκος Βασιλάκος (https://www.saferkids.gr https://www.vrtherapy.gr), αποκλειστικά στο libre, απαντά λεπτομερώς στις απορίες και τους προβληματισμούς γύρω από αυτό το νέο παράθυρο που ανοίγεται μπροστά μας.

ΑΙ. Αν μπορούσαμε επιγραμματικά να πούμε θετικά κι αρνητικά, ποια θα ήταν;

Θετικά της Τεχνητής Νοημοσύνης:

- Αυξημένη παραγωγικότητα: Η ΤΝ αυτοματοποιεί χρονοβόρες εργασίες, απελευθερώνοντας χρόνο για πιο δημιουργικές και στρατηγικές ασχολίες.

- Βελτιωμένη λήψη αποφάσεων: Η ΤΝ αναλύει μεγάλα δεδομένα, εντοπίζοντας μοτίβα και τάσεις που βοηθούν στην λήψη τεκμηριωμένων αποφάσεων.

- Καινοτομία: Η ΤΝ τροφοδοτεί νέες ιδέες και λύσεις σε διάφορους κλάδους, από την ιατρική έως την τέχνη.

- Εξατομικευμένη εμπειρία: Η ΤΝ προσφέρει εξατομικευμένες υπηρεσίες και προϊόντα, προσαρμοσμένα στις ανάγκες και τα ενδιαφέροντα του κάθε χρήστη.

- Βελτίωση της ποιότητας ζωής: Η ΤΝ έχει τη δυνατότητα να βελτιώσει την ποιότητα ζωής σε διάφορους τομείς, όπως η υγεία, η εκπαίδευση και η προστασία του περιβάλλοντος.

Αρνητικά της Τεχνητής Νοημοσύνης:

- Αντικατάσταση θέσεων εργασίας: Η αυτοματοποίηση δύναται να οδηγήσει σε απώλεια θέσεων εργασίας, ιδιαίτερα σε επαγγέλματα που βασίζονται σε τυποποιημένες εργασίες.

- Ηθικές ανησυχίες: Η χρήση της ΤΝ εγείρει ηθικά διλήμματα, όπως η μεροληψία, η διαφάνεια και η ιδιωτικότητα.

- Κίνδυνος κατάχρησης: Η ΤΝ δύναται να χρησιμοποιηθεί για κακόβουλους σκοπούς, όπως η παραπληροφόρηση, η κυβερνοεγκληματικότητα ή η ανάπτυξη αυτόνομων όπλων.

- Ανεργία: Η μαζική ανεργία ίσως αποτελέσει κοινωνικό πρόβλημα, εάν η τεχνητή νοημοσύνη αντικαταστήσει μεγάλο μέρος του εργατικού δυναμικού.

- Έλλειψη ελέγχου: Η απώλεια ελέγχου σε συστήματα τεχνητής νοημοσύνης με υψηλή αυτονομία αποτελεί ρεαλιστικό κίνδυνο.

Συνοψίζοντας: Η τεχνητή νοημοσύνη φέρει πολλαπλά οφέλη, αλλά οφείλουμε να αντιμετωπίσουμε υπεύθυνα και με προσοχή τις πιθανές αρνητικές επιπτώσεις της. Η ανάπτυξη και η χρήση της ΤΝ οφείλουν να γίνονται με ηθικό τρόπο, λαμβάνοντας υπόψη τις κοινωνικές και περιβαλλοντικές επιπτώσεις.

- Τι κινδύνους κρύβει η τεχνητή νοημοσύνη;

Η τεχνητή νοημοσύνη, παρά τα οφέλη της, φέρει και μια σειρά από κινδύνους που οφείλουμε να λάβουμε σοβαρά υπόψη. Ας δούμε μερικούς από τους σημαντικότερους:

1. Αντικατάσταση θέσεων εργασίας: Η αυτοματοποίηση που φέρνει η ΤΝ δύναται να οδηγήσει σε απώλεια θέσεων εργασίας, ιδιαίτερα σε επαγγέλματα που βασίζονται σε τυποποιημένες εργασίες. Αυτό δύναται να δημιουργήσει κοινωνικά προβλήματα, όπως ανεργία και αύξηση της ανισότητας.

2. Ηθικές ανησυχίες: Η χρήση της ΤΝ εγείρει ηθικά διλήμματα, όπως η μεροληψία, η διαφάνεια και η ιδιωτικότητα. Αλγόριθμοι τεχνητής νοημοσύνης δύναται να ενσωματώνουν κοινωνικές προκαταλήψεις, οδηγώντας σε διακρίσεις σε βάρος μειονοτικών ομάδων. Η έλλειψη διαφάνειας στη λειτουργία αλγορίθμων δύναται να δημιουργήσει προβλήματα λογοδοσίας και ελέγχου.

3. Κίνδυνος κατάχρησης: Η ΤΝ δύναται να χρησιμοποιηθεί για κακόβουλους σκοπούς, όπως η παραπληροφόρηση, η κυβερνοεγκληματικότητα ή η ανάπτυξη αυτόνομων όπλων. Η deepfake τεχνολογία, για παράδειγμα, δύναται να χρησιμοποιηθεί για τη δημιουργία ψεύτικων βίντεο με σκοπό την χειραγώγηση της κοινής γνώμης.

4. Ανεργία: Η μαζική ανεργία ίσως αποτελέσει κοινωνικό πρόβλημα, εάν η τεχνητή νοημοσύνη αντικαταστήσει μεγάλο μέρος του εργατικού δυναμικού. Η προσαρμογή της αγοράς εργασίας στις νέες συνθήκες δύναται να είναι δύσκολη και χρονοβόρα.

5. Έλλειψη ελέγχου: Η απώλεια ελέγχου σε συστήματα τεχνητής νοημοσύνης με υψηλή αυτονομία αποτελεί ρεαλιστικό κίνδυνο. Εάν η τεχνητή νοημοσύνη γίνει υπερβολικά ισχυρή, δύναται να θέσει σε κίνδυνο την ανθρώπινη αυτονομία και ασφάλεια.

6. Αλλαγές στην ανθρώπινη φύση: Η αλληλεπίδραση με την τεχνητή νοημοσύνη δύναται να επηρεάσει τον τρόπο σκέψης, συμπεριφοράς και αλληλεπίδρασης των ανθρώπων. Η υπερβολική εξάρτηση από την ΤΝ δύναται να οδηγήσει σε απομόνωση, απώλεια κοινωνικών δεξιοτήτων και αλλοίωση της ανθρώπινης φύσης.

7. Περιβαλλοντικές επιπτώσεις: Η ανάπτυξη και η χρήση της τεχνητής νοημοσύνης δύναται να έχει σημαντικές περιβαλλοντικές επιπτώσεις, όπως η αύξηση της κατανάλωσης ενέργειας και η παραγωγή ηλεκτρονικών αποβλήτων.

Είναι σημαντικό να τονίσουμε ότι οι κίνδυνοι της τεχνητής νοημοσύνης δεν είναι αναπόφευκτοι. Μέσω προσεκτικής ανάπτυξης, ηθικής χρήσης και σωστής ρύθμισης, μπορούμε να αξιοποιήσουμε τα οφέλη της ΤΝ προς όφελος της ανθρωπότητας.

Συμπέρασμα: Η τεχνητή νοημοσύνη φέρει ένα εύρος από δυνατότητες, αλλά οφείλουμε να προσεγγίσουμε την ανάπτυξη και χρήση της με κριτική σκέψη και υπευθυνότητα.

- Χρειάζεται επιμόρφωση σε τέτοια συστήματα ώστε να μην πέφτουμε σε παγίδες;

Ναι, η επιμόρφωση σε συστήματα τεχνητής νοημοσύνης (AI) κρίνεται απαραίτητη για να αποφύγουμε διάφορες παγίδες που σχετίζονται με την τεχνολογία αυτή. Ας δούμε μερικούς λόγους:

1. Κατανόηση λειτουργίας: Η επιμόρφωση βοηθά στην κατανόηση του τρόπου λειτουργίας των συστημάτων AI, συμπεριλαμβανομένων των δυνατοτήτων, των περιορισμών και των πιθανών μεροληψιών. Η γνώση αυτή είναι απαραίτητη για την κριτική αξιολόγηση των πληροφοριών που παράγουν τα συστήματα AI και για την αποφυγή λανθασμένων ερμηνειών.

2. Αξιολόγηση πληροφοριών: Η AI δύναται να χρησιμοποιηθεί για τη δημιουργία ψευδών ή παραπλανητικών πληροφοριών. Η επιμόρφωση σε AI εξοπλίζει τους πολίτες με τα απαραίτητα εργαλεία για την αξιολόγηση της αξιοπιστίας των πληροφοριών που λαμβάνουν, διακρίνοντας αξιόπιστες πηγές από παραπληροφόρηση.

3. Προστασία από κακόβουλη χρήση: Η AI δύναται να χρησιμοποιηθεί για κακόβουλους σκοπούς, όπως η κυβερνοεγκληματικότητα ή η διάδοση προπαγάνδας. Η επιμόρφωση σε AI μπορεί να βοηθήσει στην αναγνώριση και την αποφυγή τέτοιων παγίδων.

4. Ενίσχυση ψηφιακών δεξιοτήτων: Η AI διαδραματίζει ολοένα και σημαντικότερο ρόλο στην καθημερινή ζωή. Η επιμόρφωση σε AI ενισχύει τις ψηφιακές δεξιότητες, αυξάνοντας την ικανότητα των πολιτών να αξιοποιούν την τεχνολογία προς όφελός τους.

5. Συμμετοχή στη διαμόρφωση του μέλλοντος της AI: Η AI είναι μια ταχέως αναπτυσσόμενη τεχνολογία με σημαντικές επιπτώσεις στην κοινωνία. Η επιμόρφωση σε AI δίνει στους πολίτες τη δυνατότητα να συμμετέχουν ενεργά στη διαμόρφωση του μέλλοντος της τεχνολογίας, διασφαλίζοντας ηθική και υπεύθυνη ανάπτυξη.

Επιπλέον οφέλη:

- Βελτίωση της λήψης αποφάσεων

- Αύξηση της παραγωγικότητας

- Ενίσχυση της καινοτομίας

- Προώθηση της ψηφιακής ένταξης

Συμπέρασμα: Η επιμόρφωση σε συστήματα AI αποτελεί απαραίτητη προϋπόθεση για την ενεργή και υπεύθυνη συμμετοχή των πολιτών στην ψηφιακή εποχή. Η κατανόηση της τεχνολογίας AI, η κριτική σκέψη και η ψηφιακή εγρήγορση είναι απαραίτητα εργαλεία για την αποφυγή παγίδων και την αξιοποίηση των δυνατοτήτων που προσφέρει η AI.

- Τι κάνουμε σε περίπτωση που παραβιαστούν δικαιώματά μας;

Σε περίπτωση που η τεχνητή νοημοσύνη (AI) παραβιάσει τα δικαιώματά μας, υπάρχουν διάφορα βήματα που μπορούμε να λάβουμε:

1. Τεκμηρίωση: Συλλέξτε στοιχεία που αποδεικνύουν την παραβίαση, όπως screenshots, emails, ή ιστορικό πλοήγησης.

2. Ενημέρωση του υπεύθυνου φορέα: Επικοινωνήστε με τον οργανισμό ή την εταιρεία που ευθύνεται για το σύστημα AI που παραβίασε τα δικαιώματά σας. Εξηγήστε την κατάσταση και ζητήστε λύση.

3. Υποβολή καταγγελίας: Εάν η παραβίαση είναι σοβαρή ή δεν επιλυθεί από τον υπεύθυνο φορέα, μπορείτε να υποβάλλετε καταγγελία σε αρμόδιες αρχές.

Επιλογές καταγγελίας:

- Εθνική Αρχή Διαφάνειας: Εάν η παραβίαση σχετίζεται με διαφάνεια και πρόσβαση σε πληροφορίες.

- Αρχή Προστασίας Προσωπικών Δεδομένων: Εάν η παραβίαση σχετίζεται με την προστασία προσωπικών δεδομένων.

- Ρυθμιστική Αρχή Επικοινωνιών: Εάν η παραβίαση σχετίζεται με υπηρεσίες ηλεκτρονικών επικοινωνιών.

- Δικαστική προσφυγή: Σε περίπτωση σοβαρής ή μη αναστρέψιμης βλάβης, μπορείτε να εξετάσετε το ενδεχόμενο δικαστικής προσφυγής.

Συμπληρωματικά:

- Ενημερωθείτε για τα δικαιώματά σας σχετικά με την AI.

- Μάθετε πώς να διαχειρίζεστε τα δεδομένα σας και να προστατεύετε την ιδιωτικότητά σας.

- Συμμετέχετε σε συζητήσεις και ομάδες που ασχολούνται με την ηθική της AI.

- Ενθαρρύνετε την υπεύθυνη ανάπτυξη και χρήση της AI.

Προσοχή:

- Η διαδικασία αντιμετώπισης παραβίασης από AI μπορεί να είναι περίπλοκη και χρονοβόρα.

- Η νομοθεσία σχετικά με την AI είναι εξελισσόμενη και μπορεί να διαφέρει σε κάθε χώρα.

- Η ύπαρξη αρμόδιων αρχών και η αποτελεσματικότητά τους μπορεί να ποικίλλει.

Συμπέρασμα:

Η προστασία των δικαιωμάτων μας στην ψηφιακή εποχή, όπου η AI διαδραματίζει ολοένα και σημαντικότερο ρόλο, είναι καίριας σημασίας. Η ενημέρωση, η ενεργή στάση και η συλλογική προσπάθεια είναι απαραίτητα για την αντιμετώπιση πιθανών παραβιάσεων από συστήματα AI.

Την Τετάρτη 8 Μαρτίου, το Κοινοβούλιο ενέκρινε (523 υπέρ, 46 κατά και 49 αποχές) τον νόμο περί τεχνητής νοημοσύνης που διασφαλίζει την ασφάλεια και τη συμμόρφωση με τα θεμελιώδη δικαιώματα, ενώ ενισχύει την καινοτομία.

Οι νέοι κανόνες απαγορεύουν τις εφαρμογές της τεχνητής νοημοσύνης που απειλούν τα δικαιώματα των πολιτών.

Πιο συγκεκριμένα, απαγορεύονται:

- Συστήματα βιομετρικής κατηγοριοποίησης: Απαγορεύεται η χρήση βιομετρικών δεδομένων, όπως τα χαρακτηριστικά του προσώπου ή τα δακτυλικά αποτυπώματα, για την κατηγοριοποίηση ατόμων σε ευαίσθητες κατηγορίες, όπως η φυλή, η θρησκεία ή η πολιτική άποψη.

- Μη στοχευμένη συλλογή εικόνων προσώπου: Απαγορεύεται η συλλογή εικόνων προσώπου από το διαδίκτυο ή από κάμερες κλειστού κυκλώματος παρακολούθησης (CCTV) χωρίς συγκεκριμένο σκοπό ή έγκριση.

- Αναγνώριση συναισθημάτων: Απαγορεύεται η χρήση AI για την αναγνώριση συναισθημάτων σε εργασιακά ή εκπαιδευτικά περιβάλλοντα.

- Κοινωνική βαθμολογία: Απαγορεύεται η χρήση AI για την αξιολόγηση της αξιοπιστίας ή της συμπεριφοράς των ατόμων, με στόχο τον περιορισμό των δικαιωμάτων ή των ευκαιριών τους.

- Προληπτική αστυνόμευση: Απαγορεύεται η χρήση AI για την πρόβλεψη και πρόληψη εγκλημάτων, όταν βασίζεται αποκλειστικά στην κατάρτιση προφίλ ατόμων ή ομάδων.

Εκτός από τις απαγορεύσεις, ο κανονισμός θέτει αυστηρούς περιορισμούς σε άλλες εφαρμογές AI υψηλού κινδύνου, όπως η βιομετρική ταυτοποίηση από τις αρχές επιβολής του νόμου, η αξιολόγηση της πιστοληπτικής ικανότητας και η χρήση AI σε συστήματα προσλήψεων. Στόχος του κανονισμού είναι να διασφαλίσει ότι η τεχνητή νοημοσύνη θα αναπτυχθεί και θα χρησιμοποιηθεί με τρόπο ηθικό και υπεύθυνο, χωρίς να απειλεί τα θεμελιώδη δικαιώματα των πολιτών.

- Ποιες είναι αυτές οι εφαρμογές (και τα συστήματα), πώς λειτουργούν και με ποιον τρόπο απειλούν τα δικαιώματα των πολιτών;

1. Συστήματα βιομετρικής κατηγοριοποίησης:

- Λειτουργία: Χρησιμοποιούν βιομετρικά δεδομένα (π.χ. χαρακτηριστικά προσώπου, δακτυλικά αποτυπώματα) για την ταυτοποίηση ή κατηγοριοποίηση ατόμων.

- Απειλές:

- Διάκριση: Η λανθασμένη κατηγοριοποίηση μπορεί να οδηγήσει σε διακρίσεις σε βάρος μειονοτικών ομάδων.

- Παραβίαση ιδιωτικής ζωής: Η συλλογή και αποθήκευση βιομετρικών δεδομένων εγείρει σοβαρές ανησυχίες για την ιδιωτική ζωή.

- Κατάχρηση εξουσίας: Η χρήση από κυβερνήσεις ή εταιρείες για τον έλεγχο και την παρακολούθηση των πολιτών.

2. Μη στοχευμένη συλλογή εικόνων προσώπου:

- Λειτουργία: Συλλογή εικόνων προσώπου από το διαδίκτυο ή CCTV χωρίς συγκεκριμένο σκοπό ή έγκριση.

- Απειλές:

- Παραβίαση ιδιωτικής ζωής: Η μαζική συλλογή δεδομένων προσώπου αποτελεί σοβαρή απειλή για την ιδιωτική ζωή.

- Καταστολή ανεξαρτησίας: Χρησιμοποιείται για τον εντοπισμό και την παρακολούθηση ατόμων που ασκούν κριτική ή διαφωνούν.

- Προσβολή της ελευθερίας έκφρασης: Ο φόβος της παρακολούθησης μπορεί να οδηγήσει σε αυτολογοκρισία.

3. Αναγνώριση συναισθημάτων:

- Λειτουργία: Χρήση AI για την ανάλυση εκφράσεων προσώπου και την εξαγωγή συμπερασμάτων για τα συναισθήματα.

- Απειλές:

- Εισβολή στην ιδιωτική ζωή: Παραβίαση της προσωπικής σφαίρας και των σκέψεων.

- Διακρίσεις: Στερεότυπα και προκαταλήψεις στην αξιολόγηση ατόμων.

- Κατάχρηση εξουσίας: Χρησιμοποιείται για τον έλεγχο και τη χειραγώγηση της συμπεριφοράς.

4. Κοινωνική βαθμολογία:

- Λειτουργία: Αξιολόγηση της αξιοπιστίας ή της συμπεριφοράς ατόμων με βάση AI.

- Απειλές:

- Διακρίσεις: Στερεότυπα και προκαταλήψεις στην αξιολόγηση ατόμων.

- Περιορισμός ευκαιριών: Αδικαιολόγητος αποκλεισμός από πόρους ή υπηρεσίες.

- Κοινωνικός έλεγχος: Δημιουργία ενός συστήματος “τιμωρίας και ανταμοιβής” που περιορίζει την ελευθερία.

5. Προληπτική αστυνόμευση:

- Λειτουργία: Χρήση AI για την πρόβλεψη και πρόληψη εγκλημάτων με βάση προφίλ ατόμων ή ομάδων.

- Απειλές:

- Στερεότυπα και προκαταλήψεις: Στόχευση ατόμων με βάση άσχετα χαρακτηριστικά και όχι με βάση εγκληματική δραστηριότητα.

- Παραβίαση της ελευθερίας κινήσης: Περιορισμός της ελεύθερης μετακίνησης και συνάθροισης.

- Κατάχρηση εξουσίας: Χρησιμοποιείται για την καταστολή διαφωνίας και την περιθωριοποίηση ομάδων.

Η χρήση συστημάτων βιομετρικής ταυτοποίησης «σε ύστερο χρόνο» θεωρείται υψηλού κινδύνου και απαιτεί δικαστική έγκριση που θα συνδέεται με κάποιο ποινικό αδίκημα. Θα χρειαστούμε μια εξήγηση εδώ.

Σωστά, η χρήση συστημάτων βιομετρικής ταυτοποίησης “σε ύστερο χρόνο” (ex-post) όντως θεωρείται υψηλού κινδύνου και, σύμφωνα με τον νέο κανονισμό για την τεχνητή νοημοσύνη (AI), απαιτεί δικαστική έγκριση.

Τι σημαίνει “σε ύστερο χρόνο”;

Σε αντίθεση με την “ενεργή” βιομετρική ταυτοποίηση, όπου η ταυτοποίηση λαμβάνει χώρα σε πραγματικό χρόνο, η “εκ των υστέρων” βιομετρική ταυτοποίηση πραγματοποιείται σε δεδομένα που έχουν ήδη συλλεχθεί.

Γιατί θεωρείται υψηλού κινδύνου;

Η βιομετρική ταυτοποίηση “σε ύστερο χρόνο” φέρει σοβαρές ανησυχίες:

- Παραβίαση ιδιωτικής ζωής: Η μαζική ανάλυση βιομετρικών δεδομένων εγείρει σοβαρές ανησυχίες για την ιδιωτική ζωή.

- Λανθασμένη ταυτοποίηση: Τα συστήματα AI μπορεί να κάνουν λάθη, οδηγώντας σε άδικη στοχοποίηση αθώων.

- Κατάχρηση εξουσίας: Η χρήση από κυβερνήσεις ή εταιρείες για τον έλεγχο και την παρακολούθηση των πολιτών.

Πότε επιτρέπεται η χρήση;

Η “εκ των υστέρων” βιομετρική ταυτοποίηση επιτρέπεται μόνο σε εξαιρετικές περιπτώσεις και απαιτεί δικαστική έγκριση. Η έγκριση θα χορηγείται μόνο εάν:

- Συνδέεται με σοβαρό ποινικό αδίκημα: Η χρήση περιορίζεται σε σοβαρά εγκλήματα, όπως η τρομοκρατία ή η δολοφονία.

- Υπάρχουν εύλογοι λόγοι: Η χρήση βιομετρικής ταυτοποίησης κρίνεται απαραίτητη για την εξέλιξη της έρευνας.

- Λαμβάνονται μέτρα προστασίας: Εφαρμόζονται αυστηρά μέτρα προστασίας δεδομένων για την αποφυγή κατάχρησης.

Συμπέρασμα:

Η “εκ των υστέρων” βιομετρική ταυτοποίηση αποτελεί ισχυρό εργαλείο για την επιβολή του νόμου, αλλά οφείλει να χρησιμοποιείται με φειδώ και με σεβασμό στα θεμελιώδη δικαιώματα. Η απαίτηση δικαστικής έγκρισης αποτελεί σημαντικό φραγμό κατά της κατάχρησης και διασφαλίζει την υπεύθυνη χρήση της τεχνολογίας.

- Στην Ελλάδα σε τι σημείο βρισκόμαστε; Έχει ενσωματωθεί η νέα τεχνολογία στη ζωή μας;

Η Ελλάδα έχει κάνει βήματα προς την υιοθέτηση ενός ολοκληρωμένου νομικού πλαισίου για την τεχνητή νοημοσύνη (AI).

Σημαντικά γεγονότα:

- Νόμος 4961/2022: Ψηφίστηκε τον Αύγουστο του 2022, θέτοντας το πλαίσιο για την ανάπτυξη και χρήση της τεχνητής νοημοσύνης στον δημόσιο και ιδιωτικό τομέα.

- Εθνική Αρχή για την Τεχνητή Νοημοσύνη: Ιδρύθηκε τον Ιανουάριο του 2023, με αρμοδιότητες την εποπτεία, τον συντονισμό και την ανάπτυξη στρατηγικής για την τεχνητή νοημοσύνη.

- Στρατηγική για την Τεχνητή Νοημοσύνη: Εκπονήθηκε από το Υπουργείο Ψηφιακής Διακυβέρνησης, θέτοντας τους στόχους και τις προτεραιότητες της Ελλάδας στον τομέα της τεχνητής νοημοσύνης.

Παράλληλα:

- Εφαρμογή του Ευρωπαϊκού Κανονισμού για την Τεχνητή Νοημοσύνη: Η Ελλάδα, ως μέλος της ΕΕ, οφείλει να ενσωματώσει τον Ευρωπαϊκό Κανονισμό για την Τεχνητή Νοημοσύνη στο εθνικό της δίκαιο έως τον Ιούλιο του 2024.

- Δράσεις ενημέρωσης και ευαισθητοποίησης: Διοργανώνονται από διάφορους φορείς, με στόχο την ενημέρωση του κοινού για τις δυνατότητες και τους κινδύνους της τεχνητής νοημοσύνης.

Προκλήσεις:

- Ελλιπής ψηφιακή υποδομή: Η Ελλάδα υστερεί σε σχέση με άλλες χώρες της ΕΕ σε ψηφιακή ωριμότητα, θέτοντας εμπόδια στην ανάπτυξη και υιοθέτηση της τεχνητής νοημοσύνης.

- Έλλειψη εξειδικευμένου ανθρώπινου δυναμικού: Η έλλειψη επαγγελματιών με γνώσεις και δεξιότητες στον τομέα της τεχνητής νοημοσύνης αποτελεί σημαντικό εμπόδιο.

- Ανησυχίες για ηθική και διαφάνεια: Η ανάπτυξη και χρήση της τεχνητής νοημοσύνης εγείρει ηθικές και νομικές ανησυχίες, όπως η μεροληψία, η διαφάνεια και η προστασία δεδομένων.

Συμπέρασμα:

Η Ελλάδα έχει δρομολογήσει σημαντικές εξελίξεις προς την υιοθέτηση ενός ολοκληρωμένου νομικού πλαισίου για την τεχνητή νοημοσύνη. Παρόλα αυτά, υπάρχουν ακόμα προκλήσεις που πρέπει να αντιμετωπιστούν, όπως η ψηφιακή υποδομή, η έλλειψη εξειδικευμένου προσωπικού και οι ηθικές ανησυχίες. Η επιτυχημένη υλοποίηση της στρατηγικής για την τεχνητή νοημοσύνη μπορεί να ωθήσει την Ελλάδα στην ψηφιακή εποχή, φέρνοντας οικονομικά και κοινωνικά οφέλη.

Πηγές:

- Υπουργείο Ψηφιακής Διακυβέρνησης: URL Digital Governance Ministry

- Εθνική Αρχή για την Τεχνητή Νοημοσύνη: URL Artificial Intelligence Authority

- Στρατηγική για την Τεχνητή Νοημοσύνη: URL Artificial Intelligence Strategy

Η τεχνητή νοημοσύνη (AI) έχει πλέον εδραιωθεί στον επιχειρηματικό κόσμο, με ολοένα και περισσότερες επιχειρήσεις να υιοθετούν λύσεις AI για την ενίσχυση της παραγωγικότητας, της αποδοτικότητας και της λήψης αποφάσεων.

Πώς χρησιμοποιείται η AI στις επιχειρήσεις:

- Αυτοματοποίηση: Η AI αυτοματοποιεί επαναλαμβανόμενες εργασίες, απελευθερώνοντας χρόνο για πιο δημιουργικές και στρατηγικές εργασίες.

- Ανάλυση δεδομένων: Η AI βοηθά στην ανάλυση μεγάλων όγκων δεδομένων, εξάγοντας χρήσιμες πληροφορίες για την βελτίωση της λήψης αποφάσεων.

- Προβλέψεις: Η AI μπορεί να προβλέψει μελλοντικές τάσεις και συμπεριφορές, βοηθώντας τις επιχειρήσεις να προσαρμόζονται και να λαμβάνουν προληπτικά μέτρα.

- Εξατομίκευση: Η AI προσφέρει εξατομικευμένες εμπειρίες στους πελάτες, βελτιώνοντας την ικανοποίηση και την εμπλοκή τους.

Παραδείγματα εφαρμογής AI σε επιχειρήσεις:

- Chatbots: Εικονικοί βοηθοί που απαντούν σε ερωτήσεις και εξυπηρετούν πελάτες.

- Προτάσεις προϊόντων: Συστήματα που προτείνουν προϊόντα στους πελάτες με βάση τις προτιμήσεις τους.

- Ρομπότ: Αυτοματοποιημένα συστήματα που χρησιμοποιούνται στην παραγωγή και logistics.

- Ανάλυση αγοράς: Εργαλεία που βοηθούν στην κατανόηση των τάσεων της αγοράς και του ανταγωνισμού.

Πλεονεκτήματα της AI για τις επιχειρήσεις:

- Αύξηση παραγωγικότητας: Η αυτοματοποίηση απελευθερώνει χρόνο για πιο δημιουργικές εργασίες.

- Βελτίωση αποδοτικότητας: Η AI βοηθά στην εξοικονόμηση πόρων και χρόνου.

- Καλύτερες αποφάσεις: Η ανάλυση δεδομένων οδηγεί σε πιο τεκμηριωμένες και αποτελεσματικές αποφάσεις.

- Ενίσχυση εμπειρίας πελατών: Η εξατομίκευση βελτιώνει την ικανοποίηση και την εμπλοκή των πελατών.

Προκλήσεις:

- Κόστος: Η υλοποίηση λύσεων AI μπορεί να είναι δαπανηρή, ειδικά για μικρές επιχειρήσεις.

- Δεξιότητες: Η έλλειψη εξειδικευμένου προσωπικού για την ανάπτυξη και διαχείριση λύσεων AI αποτελεί πρόκληση.

- Ηθικές ανησυχίες: Η μεροληψία, η διαφάνεια και η προστασία δεδομένων εγείρουν ηθικές ανησυχίες.

Συμπέρασμα:

Η τεχνητή νοημοσύνη φέρει οφέλη και προκλήσεις για τις επιχειρήσεις. Η υιοθέτησή της με ορθολογικό τρόπο, λαμβάνοντας υπόψη τις ηθικές ανησυχίες και την ανάπτυξη των απαραίτητων δεξιοτήτων, μπορεί να οδηγήσει σε σημαντική ανάπτυξη και ανταγωνιστικότητα.

Πηγές:

- McKinsey & Company: URL McKinsey AI in Business

- Gartner: URL Gartner Top 10 Trends in AI for 2023

- Forrester: URL Forrester The State Of AI In 2023

Πώς μπορούμε να διασφαλίσουμε ότι οι θέσεις εργασίας δε θα χαθούν;

1. Επένδυση στην εκπαίδευση και κατάρτιση:

- Ενίσχυση της ψηφιακής εκπαίδευσης και ανάπτυξη δεξιοτήτων STEM (Science, Technology, Engineering, and Mathematics).

- Προγράμματα κατάρτισης για την εξοικείωση του εργατικού δυναμικού με τις νέες τεχνολογίες.

- Ενθάρρυνση της δια βίου μάθησης για την προσαρμογή στις αλλαγές της αγοράς εργασίας.

2. Δημιουργία νέων θέσεων εργασίας:

- Η AI θα δημιουργήσει νέες θέσεις εργασίας σε τομείς όπως η ανάπτυξη, η συντήρηση και η ηθική της AI.

- Επένδυση σε τομείς που δεν επηρεάζονται άμεσα από την αυτοματοποίηση, όπως η δημιουργική οικονομία και η φροντίδα ηλικιωμένων.

- Υποστήριξη της επιχειρηματικότητας και της δημιουργίας νέων επιχειρήσεων.

3. Κοινωνική προστασία:

- Εφαρμογή πολιτικών κοινωνικής προστασίας για τους εργαζόμενους που χάνουν τη δουλειά τους.

- Παροχή επιδότητων ανεργίας και προγραμμάτων επανεκπαίδευσης.

- Εισαγωγή ενός βασικού εισοδήματος για την αντιμετώπιση της ανισότητας.

4. Ηθική ανάπτυξη και χρήση της AI:

- Θέσπιση κανόνων και κατευθυντήριων γραμμών για την ηθική ανάπτυξη και χρήση της AI.

- Διασφάλιση της διαφάνειας και της λογοδοσίας των αλγορίθμων AI.

- Προώθηση της ίσης πρόσβασης στην τεχνολογία και τα οφέλη της.

Συμπέρασμα:

Η τεχνολογία, όντως, φέρει αλλαγές στον κόσμο της εργασίας. Επενδύοντας στην εκπαίδευση, στην ανάπτυξη νέων θέσεων εργασίας, στην κοινωνική προστασία και στην ηθική χρήση της AI, μπορούμε να διαχειριστούμε ομαλά τις αλλαγές και να διασφαλίσουμε ένα μέλλον με αξιοπρεπή εργασία για όλους.

Πηγές:

- McKinsey Global Institute: URL McKinsey Jobs Lost, Jobs Gained

- World Economic Forum: URL The Future of Jobs Report 2022

- European Commission: URL Artificial Intelligence: Shaping Europe’s Digital Future